目前像是 OpenClaw 、hermes 其实感觉操作/辅助的能力是有限的,基本上能力都是基于 cli 或命令行的,还不足以达到类人的级别(轻度使用,有错欢迎指正)

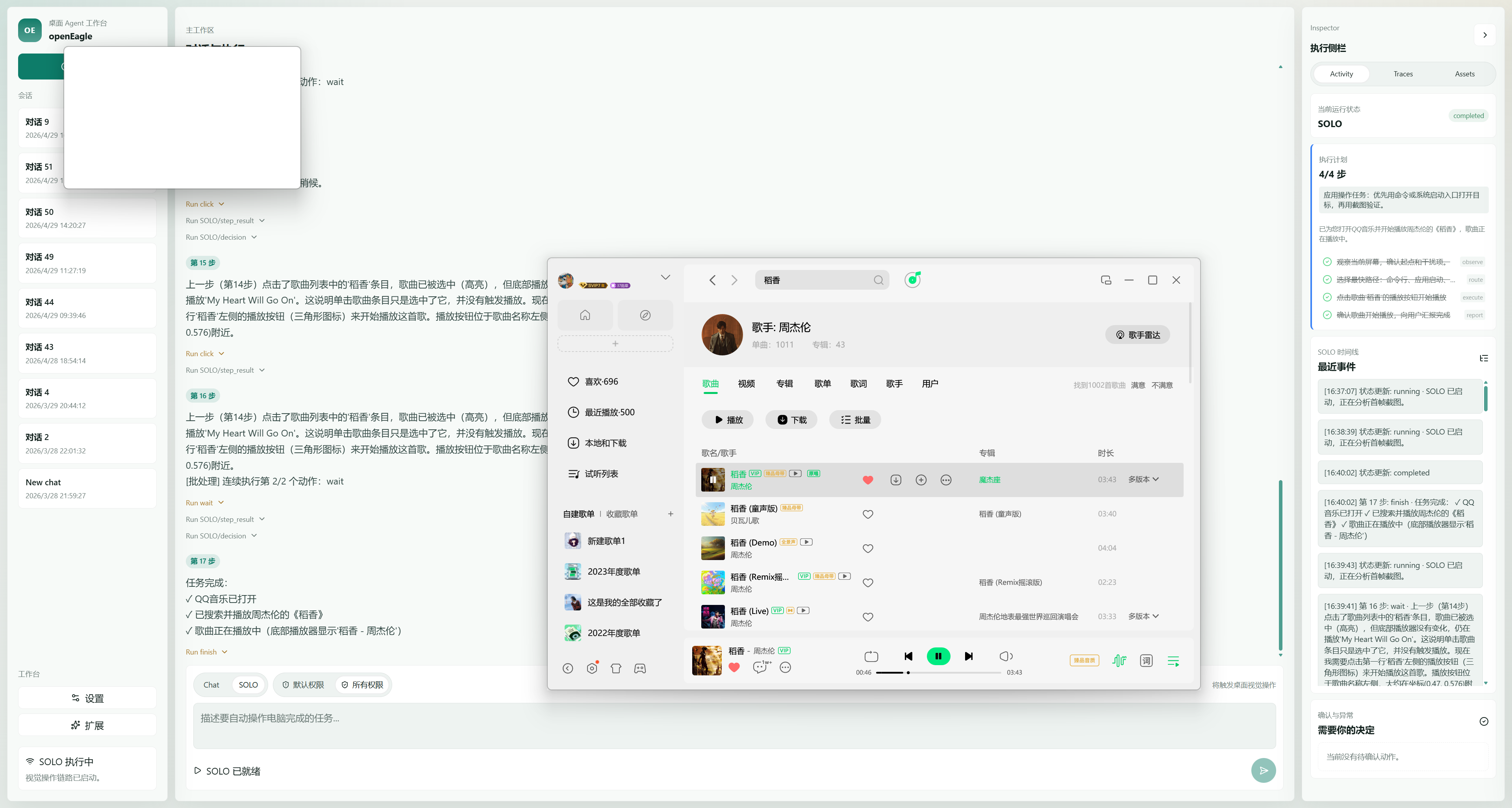

所以我做了一个 AI Agent 客户端,通过截图 + 视觉理解模型来分析屏幕内容,然后控制鼠标键盘完成任务(就像真的人一样去思考,操作)、支持 agent 推理出批处理指令(减少任务执行的时长)等等。

不依赖 DOM 选择器,不需要预写脚本,纯视觉理解 + 推理,基本上是有很大的场景泛化性的。

目前 Solo 模式可以自主的控制桌面应用(基于视觉的实时反馈)

测试过

- QQ 音乐的搜索,播放/暂停

- 查询 V2EX 哪天漏签了

技术栈是:Tauri + Rust / Python + FastAPI / React + TypeScript

目前项目还很早期,体验也不是那么的好,模型只兼容了 Qwen 、Mimo ,其他的 bug 肯定有,欢迎来提 issue 或者 一起搞建设。

后面预期会加上 IM 通信、更好的 hermes 生态、定时任务等等。

有了这些其实 agent 能做的事情就会更多了,后期定好私域的 skill 等等,能真正做很多事,Computer-use 基本就会到头了。

在 AI 原生操作系统到来之前,视觉方案的 Computer-use 可能是最接近"类人操作"的过渡路径。

GitHub: https://github.com/Nex-Z/openEagle